Nach der ersten Welle der Chatbots steht die nächste an: KI-Agenten. Sie sollen nicht mehr nur Fragen beantworten, sondern Aufgaben ausführen, Prozesse anstoßen und Entscheidungen treffen. Für Unternehmen klingt das nach einem großen Sprung. Im Alltag ist es eher ein Puzzleteil, das nur dann trägt, wenn die Voraussetzungen stimmen.

Agent oder Chatbot?

Ein Chatbot gibt Antworten. Ein Agent handelt. Er schreibt E-Mails, ruft Datenbanken ab, stößt APIs anderer Systeme an, legt Datensätze an oder löst Folgeaufträge aus. Der Unterschied ist Autonomie. Und genau darin liegt der Reiz und das Risiko.

Ein Chatbot, der eine Frage falsch beantwortet, produziert einen irritierten Kunden. Ein Agent, der eine falsche Entscheidung in ein Produktivsystem schreibt, produziert einen Folgefehler, der durch mehrere nachgelagerte Prozesse wandert. Deshalb ist der Blick auf Fehlerkosten bei der Auswahl des Einsatzgebiets wichtiger als die Frage, ob die Technologie beeindruckend aussieht.

Welche Prozesse sich wirklich eignen

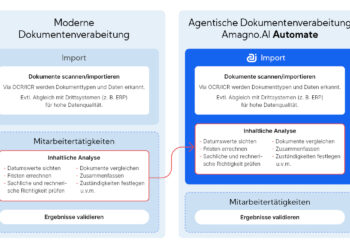

Gute Kandidaten haben drei Eigenschaften: Sie folgen klaren Regeln, arbeiten mit strukturierten Daten und liefern prüfbare Ergebnisse. Datenaufbereitung, Kategorisierung von Eingangsdokumenten und Standardkommunikation mit Kunden erfüllen diese Kriterien am zuverlässigsten. Dort ist der Einsatz nicht nur machbar, sondern oft innerhalb weniger Wochen messbar wirtschaftlich.

Schlechte Kandidaten sind Prozesse mit vielen Ausnahmen, unstrukturierten Eingaben und hohen Fehlerkosten. Kreditentscheidungen, juristische Beurteilungen, medizinische Einschätzungen. Agenten können dort assistieren, aber sie sollten nicht abschließend entscheiden.

Die praktischste Frage lautet: Kann ein Mensch im Nachgang stichprobenartig prüfen, ob das Ergebnis sinnvoll war? Wenn nicht, ist der Prozess für einen Agenten zu früh.

Technische Voraussetzungen, die oft fehlen

Ein Agent braucht Zugang zu Daten und Systemen. Das klingt selbstverständlich, ist es in vielen Unternehmen aber nicht. Ein ERP ohne API-Schicht, ein CRM mit eingefrorener Schnittstellenpolitik oder handgepflegte Excel-Tabellen als Datenstamm machen den Einstieg komplizierter als die eigentliche KI-Komponente.

Dazu kommt das Thema Datenschutz. Personenbezogene Daten, Vertragsinhalte oder vertrauliche Geschäftsdaten dürfen nicht unbedacht durch Modelle laufen, die ihre Server außerhalb der EU betreiben. Wer diese Fragen erst beantwortet, nachdem der erste Prototyp läuft, riskiert einen aufwändigen Rückbau.

Wo der Hebel am größten ist

Unternehmen, die am meisten von KI-Lösungen profitieren, haben typischerweise drei Merkmale: viele wiederholte Vorgänge, große Datenmengen aus manueller Verarbeitung und einen Fachkräftemangel in administrativen Tätigkeiten. Das trifft auf Versicherungen, Logistiker, E-Commerce und den erweiterten Mittelstand zu. Ein Handwerksbetrieb mit drei Mitarbeitenden gehört nicht in diese Liste, auch wenn in der Werbung etwas anderes suggeriert wird.

Kosten und Zeitrahmen

Ein eingegrenzter Agent für einen klar definierten Prozess ist innerhalb weniger Wochen einsatzbereit, sofern die Systemanbindung vorhanden ist. Umfassendere Systeme mit mehreren Agenten und Integration in bestehende Software brauchen drei bis sechs Monate. Die Modell- und Infrastrukturkosten sind dabei selten das Problem.

Teuer wird es an anderer Stelle: bei der Integration, dem Testen, der Pflege und den Anpassungen, wenn sich der zugrunde liegende Prozess verändert. Ein Blick auf den KI-Einsatz in der Industrie zeigt, dass gerade produzierende Branchen früh gelernt haben, Piloten klein zu halten und erst nach messbaren Ergebnissen zu skalieren. Derselbe Ansatz trägt auch im Büroalltag.

Der Pilot als ehrlicher Prüfstein

Ein Pilot über zwei bis drei Monate beantwortet die entscheidenden Fragen. Skaliert der Agent mit wachsendem Volumen? Wie oft liefert er falsche Ergebnisse und was kostet ein Fehler? Wie schnell lässt er sich anpassen, wenn sich Regeln oder Daten ändern?

Wer direkt mit einem breiten Roll-out startet, spart die Zeit der Pilotphase. Er kauft sich damit aber ein Risiko ein, das erst im Betrieb sichtbar wird und deutlich teurer ist als die paar Wochen Evaluierung.

Governance und Verantwortung

Bevor ein Agent produktiv läuft, muss geklärt sein, wer entscheidet, wenn etwas schiefgeht. Wer prüft Ergebnisse stichprobenartig? Wer nimmt neue Regeln auf? Wer greift ein, wenn der Agent sich in eine Schleife verrennt? Ohne diese Zuständigkeiten wird aus einem technischen Projekt ein organisatorisches Problem.

Hilfreich ist eine einfache Policy: Welche Aktionen darf der Agent eigenständig ausführen, welche nur vorschlagen, welche nie auslösen? Die Grenzen lassen sich technisch umsetzen, sie müssen aber vorher diskutiert und festgeschrieben sein.

Was bleibt

KI-Agenten sind kein Selbstläufer. Sie funktionieren dort gut, wo die Voraussetzungen klar sind: saubere Daten, offene Schnittstellen, verantwortliche Menschen und eine Kultur, die auf Piloten statt auf große Würfe setzt. Unter diesen Bedingungen werden sie in den kommenden Jahren zu einem spürbaren Faktor. Ohne sie bleiben sie eine teure Demonstration, die im Betrieb Probleme schafft.

Häufige Irrtümer in Auswahlgesprächen

Ein verbreiteter Irrtum ist die Annahme, ein Agent müsse mit einem möglichst großen Modell betrieben werden. In der Praxis liefert das zweit- oder drittgrößte Modell eines Anbieters vergleichbare Ergebnisse bei spürbar niedrigeren Kosten. Wer Modellwahl als einmalige Grundsatzentscheidung betrachtet, zahlt über Monate drauf.

Ein zweiter Irrtum betrifft die Integrationstiefe. Viele Vorhaben scheitern daran, dass der Agent mit zu vielen Systemen gleichzeitig sprechen soll. Ein reduzierter Scope mit einer einzigen Datenquelle und einem einzigen Zielsystem trägt mehr, als ein Agent, der theoretisch alles kann, praktisch aber an Schnittstellenfehlern hängen bleibt.

Dritter Irrtum: Der Agent ersetzt den Prozess. Er tut es nicht. Er arbeitet innerhalb des bestehenden Prozesses. Wer einen schlechten Prozess automatisiert, hat anschließend einen schnellen, schlechten Prozess. Die Vorarbeit bleibt also: Prozess anschauen, vereinfachen, dann automatisieren.

Ein pragmatischer Blick auf Schnittstellen

Schnittstellen sind der Ort, an dem KI-Projekte in der Praxis am häufigsten stecken bleiben. Ein Modell schreibt die richtige Antwort, aber das Zielsystem nimmt sie nicht entgegen, weil ein Feld fehlt oder das Datumsformat nicht passt. Solche Kleinigkeiten kosten Wochen, obwohl die eigentliche Modellarbeit längst fertig ist.

Die Empfehlung ist einfach: Vor dem Start mit den Verantwortlichen der Zielsysteme sprechen. Welche Felder sind Pflicht, welche optional? Was passiert, wenn ein unerwartetes Format kommt? Gibt es eine Sandbox, in der man die Integration testen kann? Diese Fragen gehören in die Projektdefinition, nicht in die dritte Projektwoche.

Messen, was wirklich zählt

Viele Projekte messen Dinge, die gut aussehen, aber wenig sagen. Durchschnittliche Antwortzeit, Anzahl verarbeiteter Dokumente, Nutzerzufriedenheit auf einer Skala von eins bis fünf. Das sind Kennzahlen, keine Erfolgsindikatoren.

Sinnvoller ist der Blick auf Durchlaufzeiten von Ende zu Ende, auf Fehlerquoten in nachgelagerten Systemen und auf die Stichprobenprüfung durch Fachkräfte. Eine Rechnung, die der Agent korrekt klassifiziert hat, aber in die falsche Kostenstelle bucht, ist kein erfolgreicher Fall, auch wenn die Metrik grün leuchtet.

Monatliches Review mit klarem Format, verantwortlicher Person und dokumentierten Entscheidungen ist das Mindestmaß. Ohne dieses Review verlieren Projekte den Bezug zu den Zielen, für die sie eigentlich gestartet wurden.